Inteligencia Artificial de Google en 2022

Google presenta: AI@ ’22

Se transmitio en vivo el 2 nov 2022

Vea a los equipos de investigación e inteligencia artificial de Google hablar sobre nuestro trabajo más reciente en los campos de la robótica, la comprensión del lenguaje natural, la accesibilidad, la atención médica y la creatividad. #GoogleAI Capítulos de #GoogleResearch :

0:00 -Sundar Pichai

2:09 – Jeff Dean

5:03 – Katherine Chou

10:19 – Douglas Eck

23:00 – Zoubin Ghahramani

31:30 – James Manyika y Marian Croak

Ver Conoce a un investigador de Google

#aiforsocialgood #aprincipios #generativeai #googleai #googleresearch #saludai #aprendizaje automático #innovaciónresponsable

Presentación

Sundar Pichai

Hola a todos. Gracias por acompañarnos hoy. Google comenzó hace 24 años con la gran misión de organizar la información del mundo y hacerla universalmente accesible y útil. La IA ha sido una forma importante de abordar nuestra misión. En 2001, usábamos una versión simple de aprendizaje automático para sugerir mejores ortografías en la búsqueda. Y para 2011, las técnicas de aprendizaje profundo estaban ayudando a allanar el camino para cosas como un mejor reconocimiento de voz y mapas más precisos.

Una década más tarde, la IA impulsa muchos de los productos que la gente usa todos los días, desde buscar y traducir hasta álbumes de fotos y cámaras con capacidad de búsqueda que representan una gama más amplia de tonos de piel. Y Google Cloud brinda capacidades avanzadas de IA a las organizaciones ayudándolas a innovar y hacer crecer su negocio.

Al mismo tiempo, estamos viendo cómo la IA está ayudando con el socorro en casos de desastre, la atención médica, la educación, las artes y más. Vemos muchas oportunidades por delante y estamos comprometidos a asegurarnos de que la tecnología se construya al servicio de ayudar a las personas. Como cualquier tecnología de transformación, la IA conlleva riesgos y desafíos. Es por eso que Google se enfoca en la IA responsable desde el principio, publicando principios de IA que priorizan la seguridad y la privacidad de las personas sobre cualquier otra cosa.

Hoy, compartiremos más sobre nuestro progreso, así como las primeras investigaciones que le muestran hacia dónde nos dirigimos. La IA es la tecnología más profunda en la que estamos trabajando, pero todavía estamos en los primeros días. Con muchas ganas de trabajar con expertos y socios en los próximos años para asegurarnos de que todos se beneficien de las oportunidades que crea. Con eso, quiero decir gracias por estar aquí. Espero que todos disfruten el evento. Le daré la palabra a Jeff ahora.

IA de Google

Jeff Dean

Hola a todos. Gracias por venir y bienvenido a AI en Google. Hemos hecho grandes avances en el campo de la IA durante la última década para que las computadoras ahora puedan ver, escuchar y comprender el mundo que las rodea. Y la IA es realmente esencial para cumplir con la misión de Google.

Entonces, el equipo que dirijo, Google Research, cumple esa misión resolviendo problemas fundamentales en ingeniería científica, particularmente en inteligencia artificial en estos días. Estamos entusiasmados de que Google esté a la vanguardia de la IA, no solo en el aspecto técnico, sino también en descubrir cómo implementarla de manera responsable de manera que ayude a las personas en todo el mundo. Eso significa implementar IA en nuestros productos, desde la Búsqueda de Google hasta teléfonos Pixel y muchos otros, hasta Google Cloud para ayudar a otras empresas a usar IA para resolver sus problemas y trabajar para avanzar en muchos campos de la ciencia y otros esfuerzos humanos. Escuchará anuncios hoy en tres áreas diferentes. Primero, en IA para el bien social, hemos estado trabajando mucho sobre cómo podemos usar la IA para cosas como la adaptación climática.

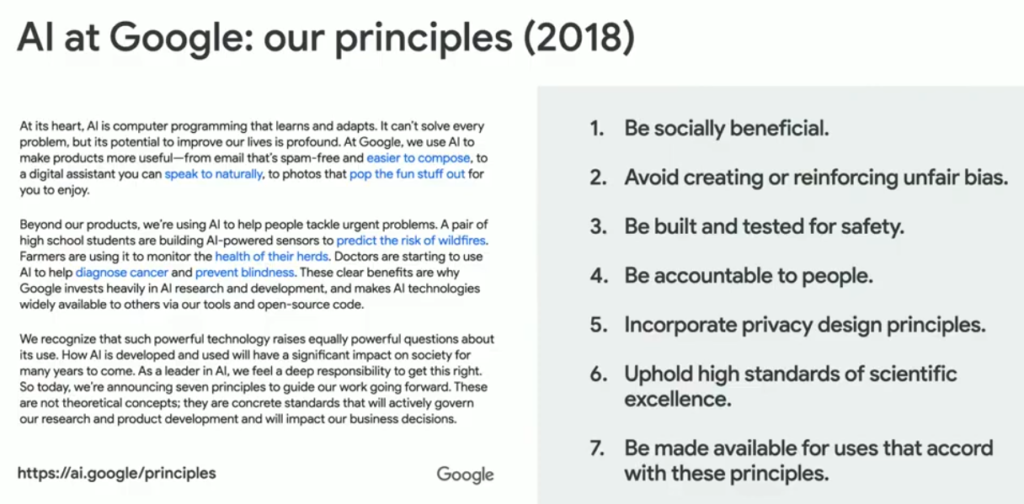

En segundo lugar, usar IA para ayudar a desbloquear la creatividad humana. Y tercero, en el uso de IA para hacer que la tecnología sea accesible en muchos más idiomas en nuestro trabajo de IA para la inclusión lingüística. También discutiremos lo que aprendimos sobre los diversos desafíos y riesgos que plantea la IA como tecnología emergente, y hablaremos sobre cómo nuestros principios de IA que presentamos en 2018 guían nuestro trabajo para asegurarnos de que nuestras tecnologías ayuden a las personas y beneficien a la sociedad en general.

Y hablaremos sobre por qué lograr que la IA sea correcta debe ser un esfuerzo colectivo, que involucre no solo a investigadores, sino también a expertos en el dominio, desarrolladores, miembros de la comunidad, empresas, gobiernos y ciudadanos. El progreso en IA puede sentirse especialmente rápido en este momento. Pero esto en realidad ha sido muchos, muchos años en la fabricación. Conocí por primera vez las redes neuronales cuando era un estudiante universitario muy entusiasmado en 1990.

Hice mi tesis de último año sobre el uso de computación paralela para entrenar redes neuronales. En ese momento, las redes neuronales podían resolver problemas realmente interesantes, pero del tamaño de un juguete. Así que pensé que si pudiéramos usar la computadora paralela de 32 procesadores en el departamento, podríamos lograr que las redes neuronales hicieran cosas realmente impresionantes con 32 veces más poder de cómputo. Yo estaba muy lejos. Resulta que necesitábamos aproximadamente un millón de veces más poder computacional antes de que las redes neuronales pudieran escalar a problemas del mundo real.

Pero ahora tenemos ese poder de cómputo y las redes neuronales están haciendo cosas realmente impresionantes. El evento de hoy trata sobre una visión esperanzadora para el futuro. Queremos volver a imaginar cómo la tecnología puede ser útil en la vida de las personas. Lamento no poder estar con todos ustedes en persona, pero disfruten de todas las cosas nuevas que verán hoy. Gracias.

IA para la salud y ayuda social

Katherine Chou

Hola a todos. Soy Katherine Chou, directora sénior de Investigación e Innovación de Google. Siempre me ha importado mucho el bienestar de la sociedad y creo que la tecnología, si se hace bien, puede generar un cambio positivo. Lo he visto de primera mano siendo parte de un grupo en Kenia llamado LEWA.

LEWA apoya la conservación comunitaria, ayudando a las personas con el cuidado de la salud, la educación, su medio ambiente y la vida silvestre. Aquí hay una foto mía y de un rinoceronte huérfano en Kenia. La tecnología bien hecha y en asociación con las comunidades locales puede promover causas como esta. Hoy me gustaría compartir cómo la investigación de Google está utilizando la IA para avanzar en algunos de los mayores desafíos de la humanidad.

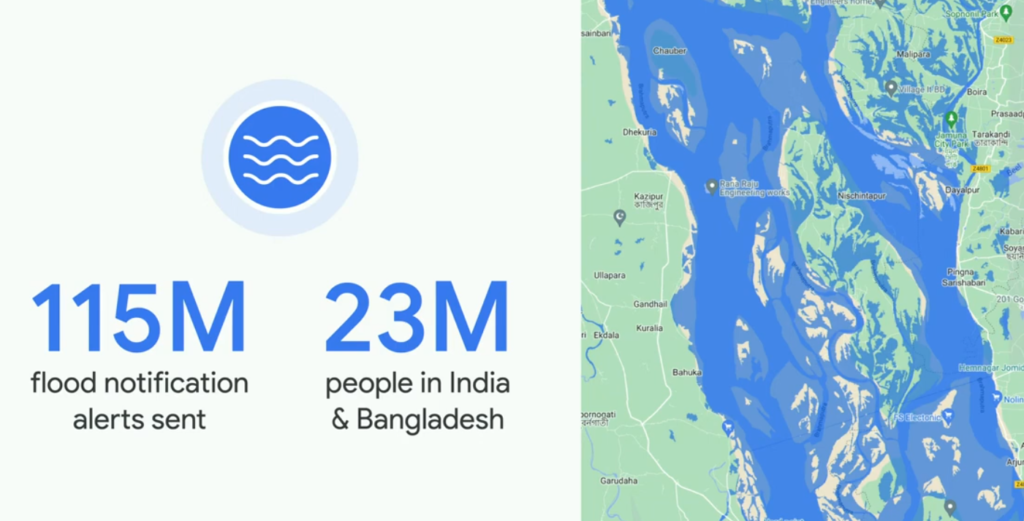

Un esfuerzo que estamos orgullosos de anunciar es la expansión de una iniciativa de previsión de inundaciones. Las inundaciones cobran decenas de miles de vidas y generan miles de millones de dólares en daños en todo el mundo cada año. Sus impactos son particularmente severos para las personas en regiones de bajos recursos, que a menudo carecen de sistemas efectivos de alerta temprana.

La previsión precisa y accesible tiene el potencial de reducir las muertes y los daños económicos entre un 30 % y un 50 %.

El año pasado enviamos 115 millones de notificaciones de inundaciones a 23 millones de personas en India y Bangladesh, dirigiéndolos a alertas de inundaciones a través de la búsqueda y los mapas de Google. La investigación inicial del Centro de Crecimiento Económico de Yale, con el apoyo de Google.org, descubrió que nuestras notificaciones triplicaron la cantidad de personas que recibieron alertas de inundaciones y cuadruplicaron la cantidad de medidas de protección tomadas.

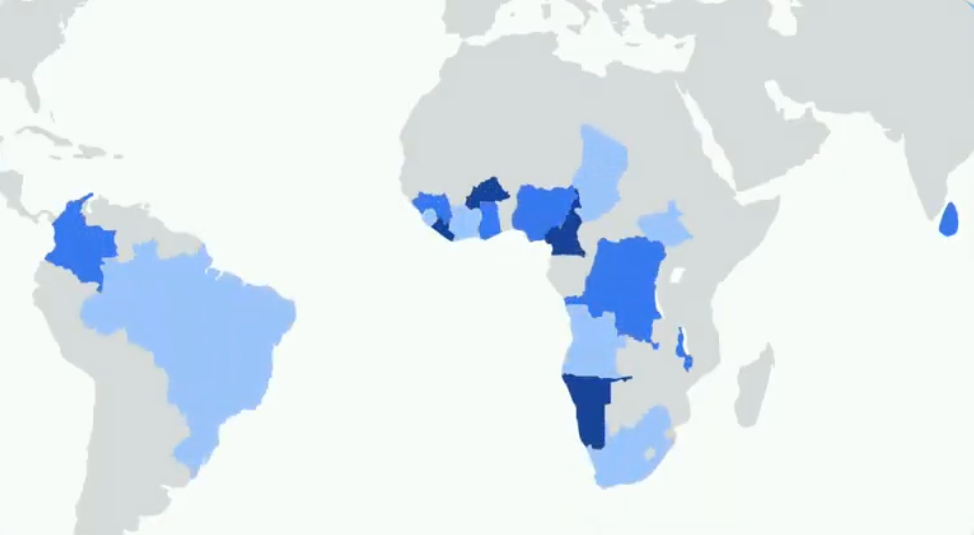

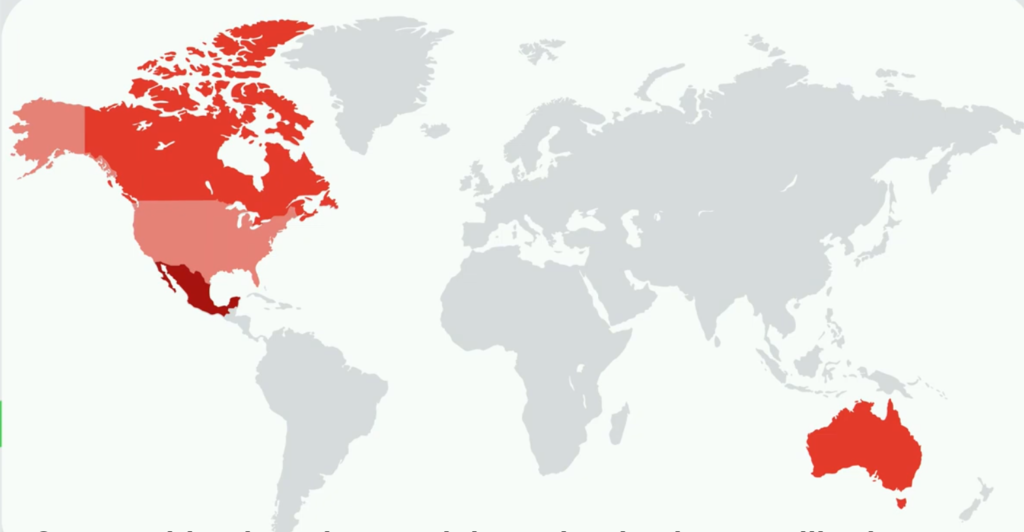

Hoy me complace anunciar la expansión de nuestra cobertura de alerta de inundaciones a 18 nuevos países, incluidos Brasil, Colombia, Sri Lanka y 15 países africanos, incluidos Chad, Nigeria, la República del Congo y Sudáfrica.

Nuestro equipo también está abordando los incendios forestales, que han ido en aumento en las últimas décadas y se espera que empeoren en los próximos años debido al cambio climático. Cada año, los incendios forestales causan miles de millones de dólares en daños y producen más de 7 gigatoneladas de emisiones de dióxido de carbono.

Nuestros modelos de aprendizaje automático, entrenados con imágenes satelitales, nos permiten identificar y rastrear incendios forestales en tiempo real y predecir cómo se propagarán, lo que nos permite ayudar a los bomberos y otros socorristas.

Hoy estamos orgullosos de anunciar nuestro sistema de detección de incendios forestales en EE. UU., Canadá, México y otras partes de Australia. Más allá del seguimiento y la predicción de desastres, nos complace anunciar que nuestra tecnología también es compatible con la ayuda posterior al desastre.

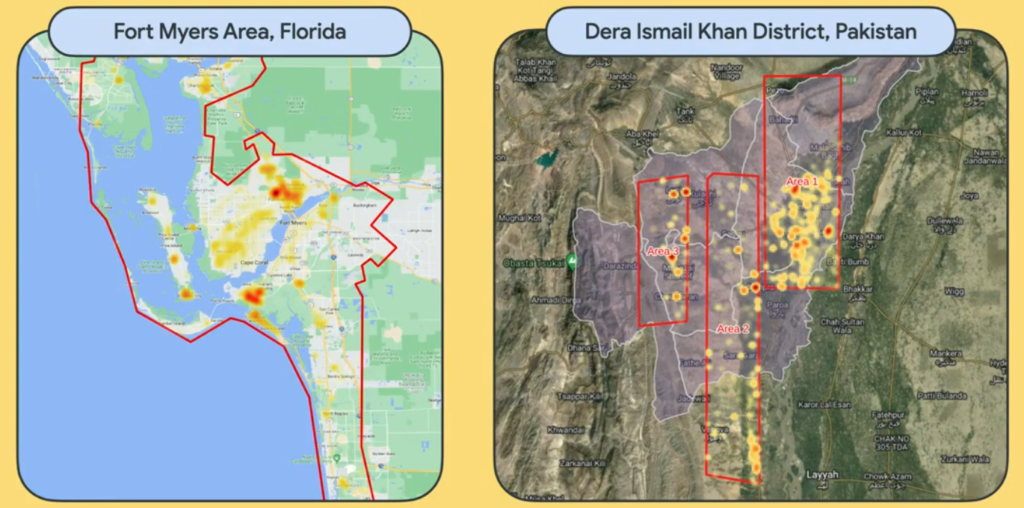

En colaboración con el Programa de Alimentos Rurales de la ONU, desarrollamos una herramienta de aprendizaje automático que analiza imágenes satelitales para identificar edificios dañados después de desastres. Esta herramienta brinda a los respondedores de crisis información crucial sobre las áreas más afectadas en los primeros días del esfuerzo de respuesta.

Después del huracán Ian, nuestra tecnología evaluó más de 400 000 edificios e identificó 69 000 edificios dañados. Esto permitió a la organización benéfica GiveDirectly entregar $2 millones a más de 2900 familias de bajos ingresos que viven en áreas muy afectadas, a partir de una semana después de la llegada de tierra.

Usamos la misma tecnología para apoyar los esfuerzos de socorro del gobierno durante las recientes inundaciones en Pakistán. Esperamos continuar empoderando a las organizaciones para que entreguen ayuda más rápido a quienes más la necesitan. Además de abordar los desafíos ambientales, también estamos utilizando la IA para avanzar en las fronteras de la medicina y brindar a las personas información crítica sobre la salud, incluso cuando el acceso a la atención es limitado.

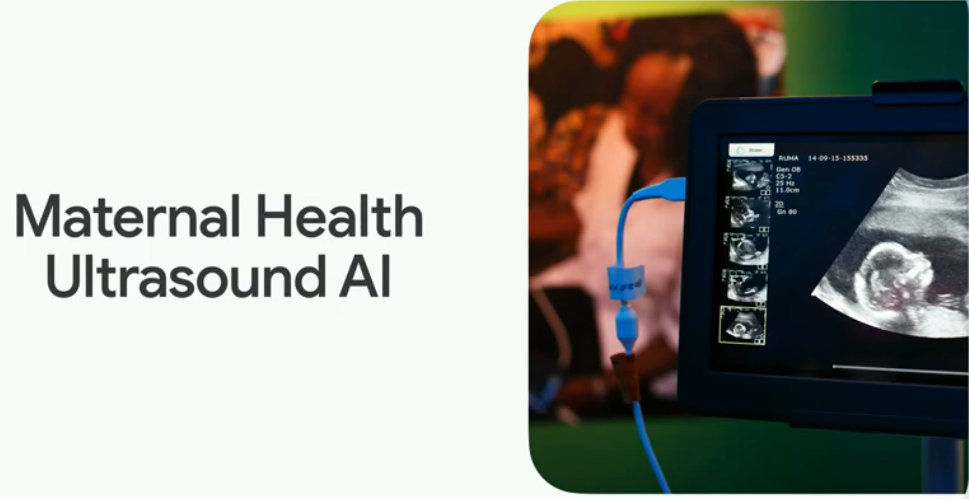

Uno de nuestros proyectos de investigación tiene como objetivo mejorar las tasas de supervivencia materna en regiones sin ecografistas. Nos hemos asociado con Northwestern Medicine para desarrollar IA que ayude a las enfermeras y parteras a recopilar e interpretar fácilmente las imágenes de ultrasonido. Nuestra herramienta de IA tiene la capacidad de determinar la posición fetal y la edad gestacional, lo cual es fundamental para ayudar a los trabajadores de la salud a identificar problemas al principio del embarazo.

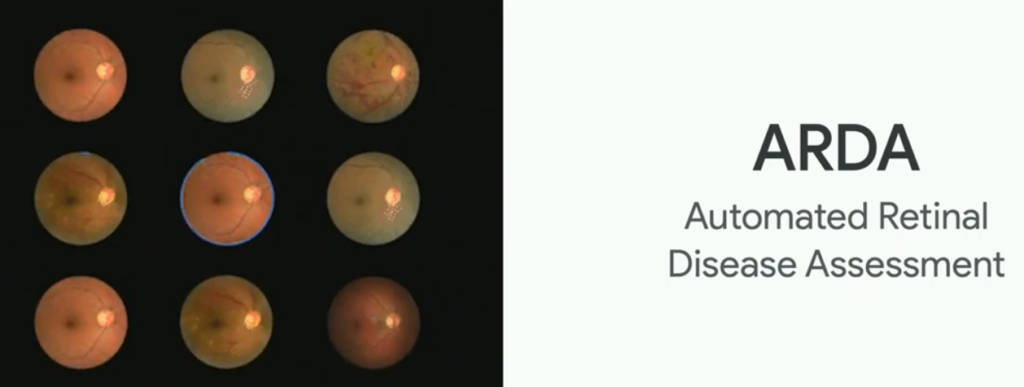

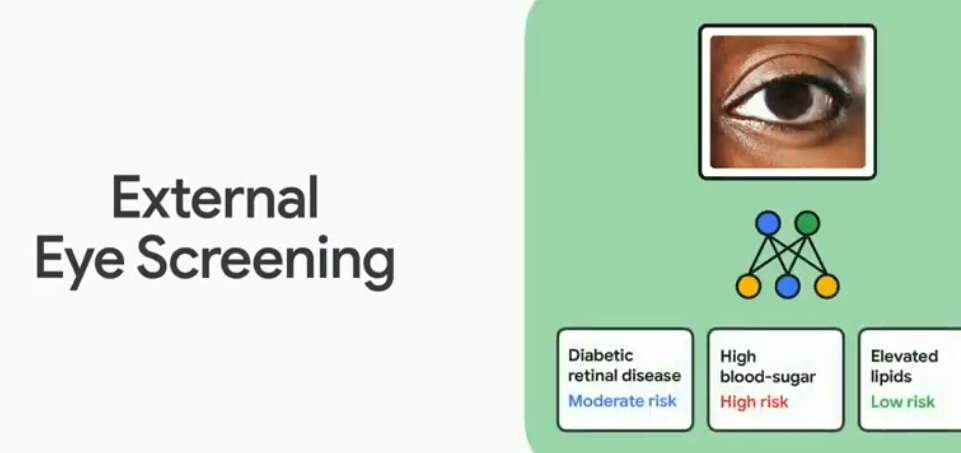

Es importante destacar que esta tecnología puede ejecutarse en el dispositivo, en dispositivos de bajo costo sin conectividad, lo que la hace útil en regiones con infraestructura limitada. También estamos impulsando el futuro de las aplicaciones de inteligencia artificial para la salud en los teléfonos de los consumidores. Uno de nuestros esfuerzos más antiguos es la retinopatía diabética, una de las principales causas de ceguera evitable en todo el mundo. Trabajando con agencias de salud pública, hemos llegado a más de 150,000 pacientes usando ARDA, o Evaluación Automatizada de Enfermedades de Retina.

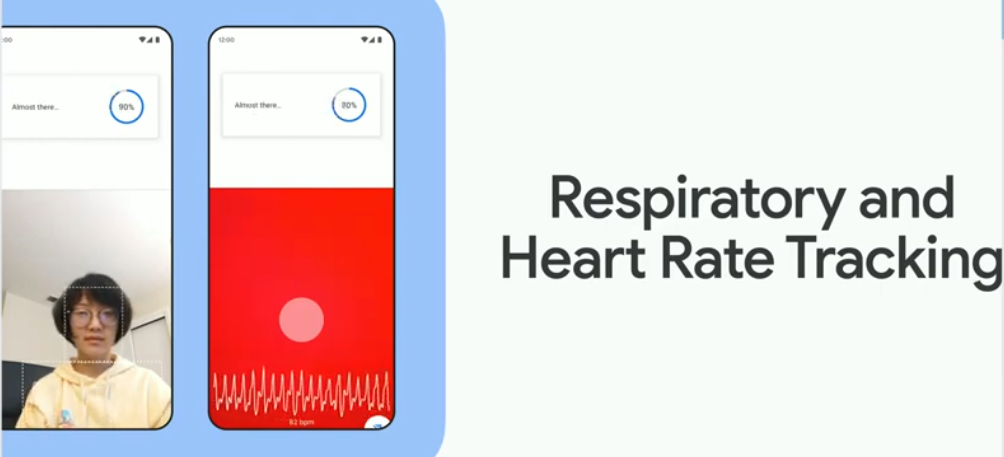

Solo en el último año, hemos duplicado sus proyecciones. Nuestros avances en visión por computadora también están permitiendo que los teléfonos se conviertan en medios poderosos para clasificar la atención mediante la detección de signos vitales como la frecuencia cardíaca y la frecuencia respiratoria.

Estas herramientas ahora están siendo utilizadas por cientos de miles de usuarios de Android. Y el mes pasado, ampliamos nuestras capacidades para detectar perturbadores del sueño como tos y ronquidos. Esta es la primera vez que las personas tendrán fácil acceso a información longitudinal sobre su salud respiratoria.

Todavía tenemos muchos desafíos que abordar si vamos a mejorar el bienestar general y el de nuestro planeta. Espero que esto te ayude a imaginar el potencial de la IA para crear un futuro mejor.

Esperamos poder compartir aún más avances con usted la próxima vez. Ahora se lo pasaré a Doug, quien hablará sobre nuestro trabajo en IA generativa. Doug, por favor.

IA generativa

Douglas Eck

Gracias de nuevo, Kat. Buenos días a todos. Mi nombre es Doug. Dirijo un equipo de investigación en Google centrado en la IA generativa. Esa es una clase de modelos donde se desbloquea la agencia creativa . He estado haciendo esto durante mucho tiempo.

En mis 25 años en esta carrera, nunca he visto tantos avances en el espacio generativo como los que he visto en los últimos meses. El ritmo de la innovación es realmente increíble.

Hoy, me gustaría aprovechar la oportunidad para mostrarles algunas de nuestras investigaciones.

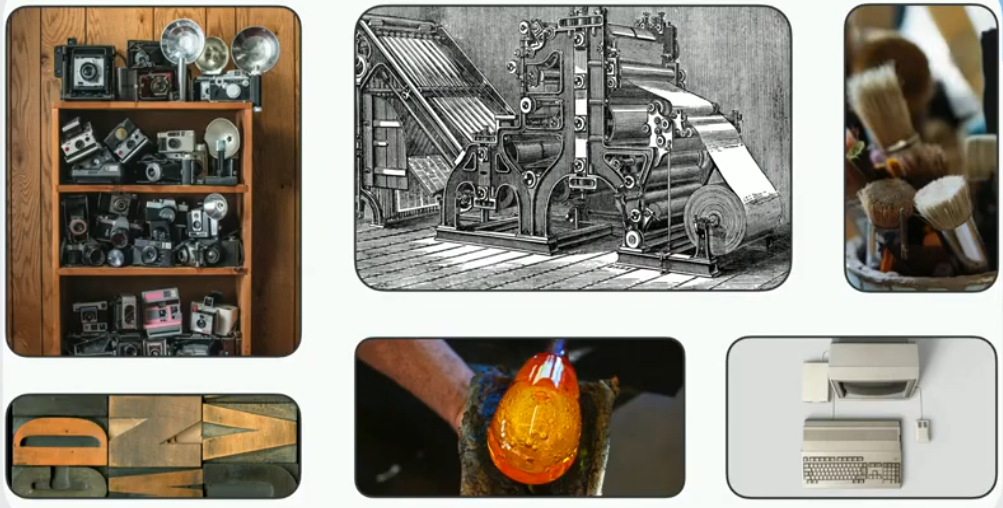

A lo largo de la historia, la tecnología se ha utilizado para expresarnos. Tenemos la imprenta. Tenemos la cámara de cine. Tenemos incluso soplado de vidrio. Y esperamos extender esa tradición mediante la creación de herramientas que organicen la información, fomenten la creatividad y preserven la creatividad. Entonces, ya sea que se trate de encontrar algo nuevo o de hacer algo nuevo, Google está aquí para ayudarlo.

Y no hay mejor ejemplo de esto que la IA generativa. Estos modelos pueden generar texto, código, audio, imágenes, video, etc., lo que puede tener un gran impacto en el desbloqueo del potencial creativo. Y creo que uno de los avances más importantes del último año son los modelos que dan a los usuarios control sobre este proceso. Se trata de controlar. Ya no se trata de modelos generativos que solo pueden generar una imagen realista.

Se trata de ser capaz de hacer algo que hayas creado tú mismo con un mensaje de texto o alguna otra entrada. Y no puedo enfatizar lo suficiente lo importante que puede ser este control. ¿Por qué? Bueno, porque yo también soy una especie de artista. Mi licenciatura, bastante rara para Google, es en literatura inglesa, escritura creativa. Más tarde me mudé a Ciencias. Toco la guitarra y el piano. Para los fanáticos de la guitarra, esa es una guitarra para diestros al revés. Soy zurdo con un golpeador adicional agregado. No soy un profesional en nada de esto, pero me da mucha alegría.

Entonces, para mí, es esencial que seamos honestos con el aspecto creativo de lo que estamos haciendo. La tecnología debe satisfacer nuestra necesidad de tener agencia y control creativo sobre lo que hacemos.

Siempre ha habido una interacción entre el arte y la tecnología. Pero los modelos generativos ahora son diferentes a la guitarra eléctrica. Esto se debe a que en realidad pueden hacernos avanzar más profundamente en nuestro proceso de creación para ayudarnos a componer, editar y generar nuevas materias primas. A su vez esto nos brinda nuevas formas de hacer arte y música, algo que me emociona mucho. Así que empecemos.

Algunos ejemplos. Me gustaría comenzar con la escritura asistida. El año pasado, presentamos Lambda, un motor de diálogo habilitado para involucrar a los usuarios en una serie de temas. Luego, algunos de nosotros en Google comenzamos a preguntarnos cómo podríamos usar Lambda para la escritura creativa.

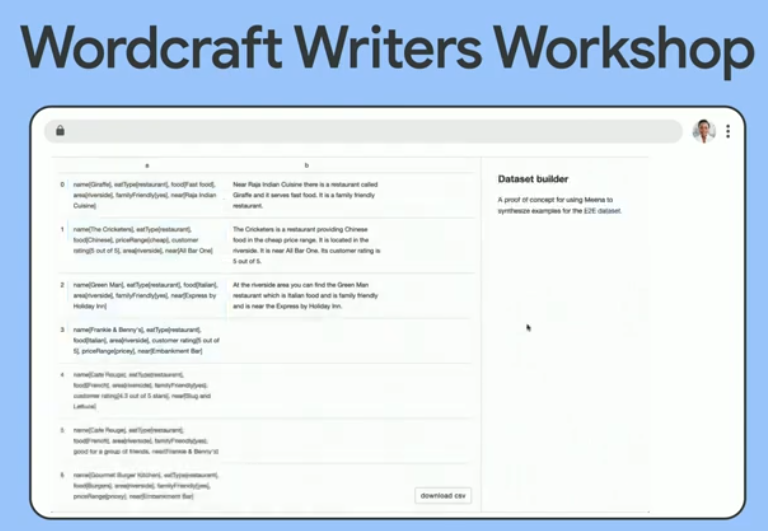

Y esto llevó a nuestra pregunta de investigación. ¿Podría un motor de diálogo como Lambda ayudar a los escritores a contar historias o incluso generar nuevas ideas para ayudarnos a superar el bloqueo del escritor? Y esa pregunta de investigación se convirtió en la inspiración detrás de nuestro taller de escritores de Wordcraft. Desafiamos a varios autores profesionales a escribir ficción experimental utilizando Lambda como herramienta. Pensé que las historias eran geniales. Y espero que tú también lo hagas.

Pronto los publicaremos junto con nuestro trabajo de investigación. Un hallazgo claro fue que usar Lambda para escribir historias completas es un callejón sin salida. Es una herramienta mucho más efectiva cuando se usa para agregar sabor, un carácter particular o para mejorar un aspecto de la historia.

También aprendimos que la interfaz de usuario tiene que ser la correcta.

La herramienta Wordcraft que está viendo aquí fue diseñada desde cero para permitir que los escritores interactúen con modelos generativos. Piense en ello como un editor de texto con un propósito. Sin ella, sería imposible que los escritores hicieran su trabajo. Estoy muy entusiasmado con la calidad de la escritura. Creo que disfrutará leyendo estas historias tanto como nosotros y aprenderá cómo Lambda desempeñó un papel en el proceso creativo. Los invito a ver su trabajo. Verá seis de ellos en esta diapositiva y encontrará más en este enlace.

Ahora hablemos del código. También estamos explorando cómo la IA puede ayudar en el desarrollo de software. Una vez más, volvamos a hacer la conexión con la escritura. Desarrollar código es muy parecido a la escritura creativa.

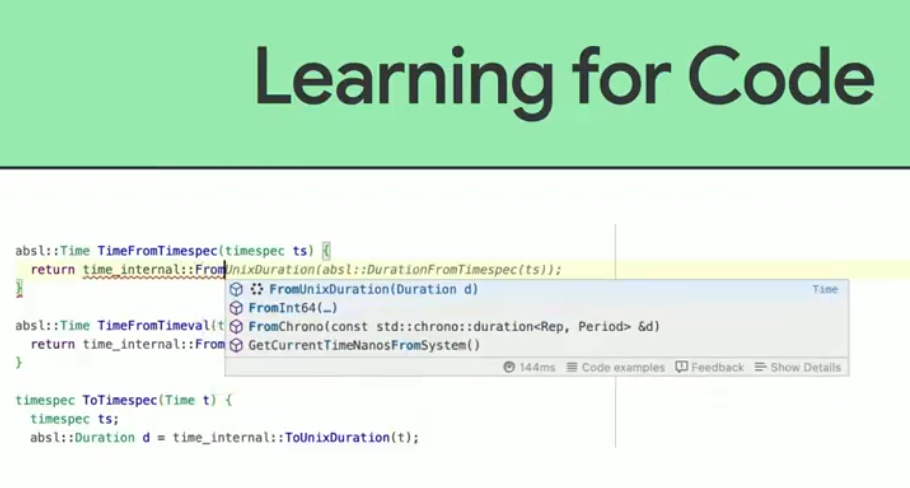

Y nuestro proyecto Learning for Code, más concretamente, está explorando cómo generar sugerencias de código de IA mediante la combinación de modelos de lenguaje con repositorios de código. Probamos esto internamente en Google al proporcionarles a nuestros desarrolladores una sola línea y finalización de código de línea larga. Todavía está en los primeros días, pero ya hemos visto una mejora en el tiempo de iteración de codificación en un 6 %.

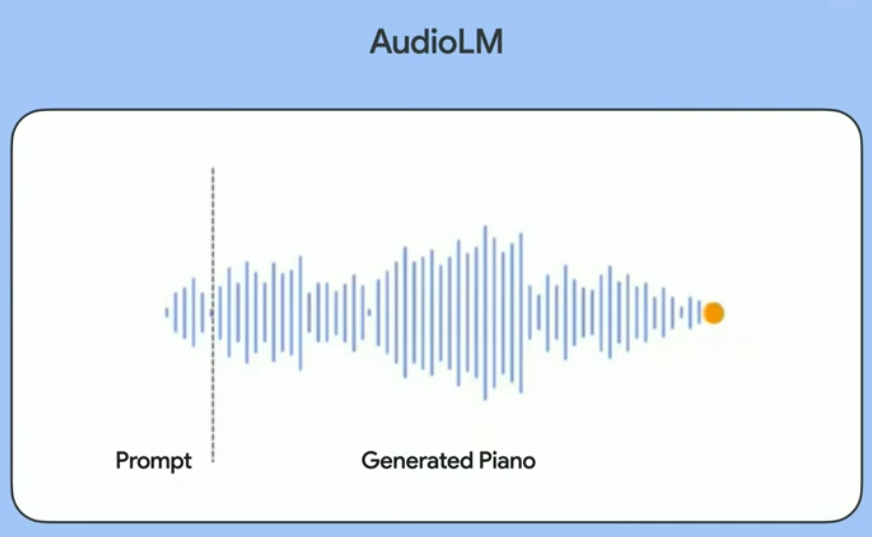

Pasemos ahora al audio. Google presentó recientemente AudioLM, un marco que puede generar voz y música de alta fidelidad a partir de una pequeña muestra de audio proporcionada por el usuario. Esto nos proporciona control sobre la salida, por lo que es mucho más que la generación de audio con un botón. Escuchemos este clip de AudioLM. Una cosa que me cita sobre AudioLM es que no requiere anotación experta.

En este ejemplo, no había necesidad de una partitura musical. Continuó el audio directamente desde el audio en el espacio de audio, y puede funcionar con cualquier clip de audio que le pidas que extienda. Las aplicaciones creativas aquí son emocionantes de imaginar.

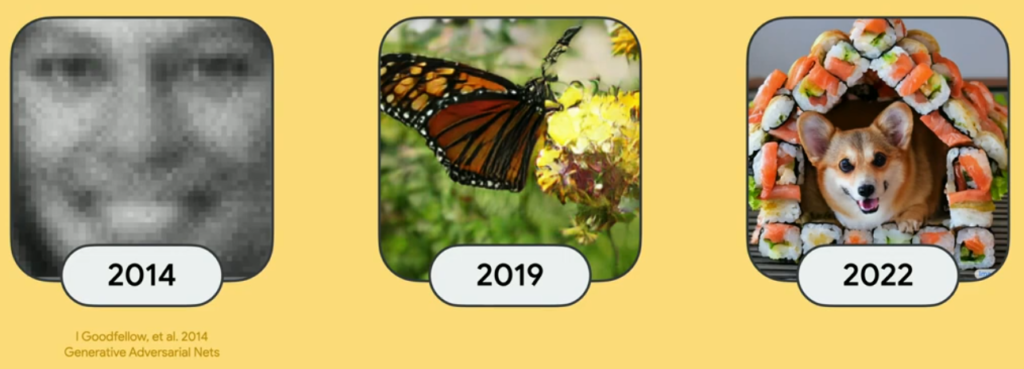

Ahora me gustaría sumergirme en un tema que probablemente sea el más visible y popular, los modelos de texto a imagen. Para configurar rápidamente el contexto de lo lejos que hemos llegado en cinco años, eche un vistazo a estas imágenes generadas por IA de 2014 a 2019 y ahora hoy.

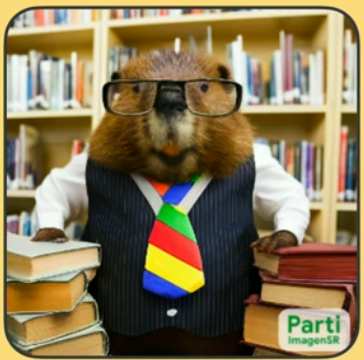

A principios de este verano, le presentaron Imagine y Partee, dos modelos diferentes que tienen una capacidad impresionante para generar imágenes a partir de indicaciones de texto. Estos modelos toman diferentes enfoques para la generación de texto a imagen. Efectivamente, Partee es más sobre el texto en texto a imagen. Utiliza modelado de lenguaje para generar una imagen directamente, y resulta que es realmente bueno para escuchar el aviso y crear la imagen correcta.

Por ejemplo, aquí el mensaje es un castor digno que usa anteojos, un chaleco y una corbata colorida. Está de pie junto a una pila alta de libros en la biblioteca. Y como puede ver, el modelo captura esa intención. Imagen es más sobre la imagen en texto a imagen.

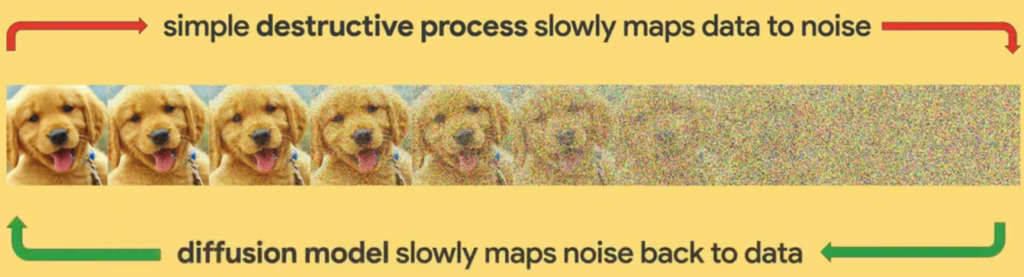

La tecnología subyacente, la difusión, es buena para generar imágenes con una resolución cada vez mayor. La intuición básica aquí es que la difusión aprende a generar estructura a partir del ruido. Entonces, ¿por qué dos enfoques? Porque nunca sabemos cuándo ocurrirán las victorias de la investigación. Realmente no sabemos qué va a funcionar hasta que lo intentamos. Y estamos muy contentos de que dos equipos prueben dos áreas diferentes. Esta vez sucedió que ambos enfoques funcionaron muy bien.

También estamos trabajando en nuevas formas creativas de usar las tecnologías centrales desarrolladas en Imagine y Partee. Nuestro proyecto Dreambooth es como un fotomatón personalizado. Tú eliges el tema. En este ejemplo, he seleccionado una imagen de un corgi. Dreambooth me permite colocar la imagen del corgi en casi cualquier entorno que pueda imaginar, por ejemplo, en la acrópolis.

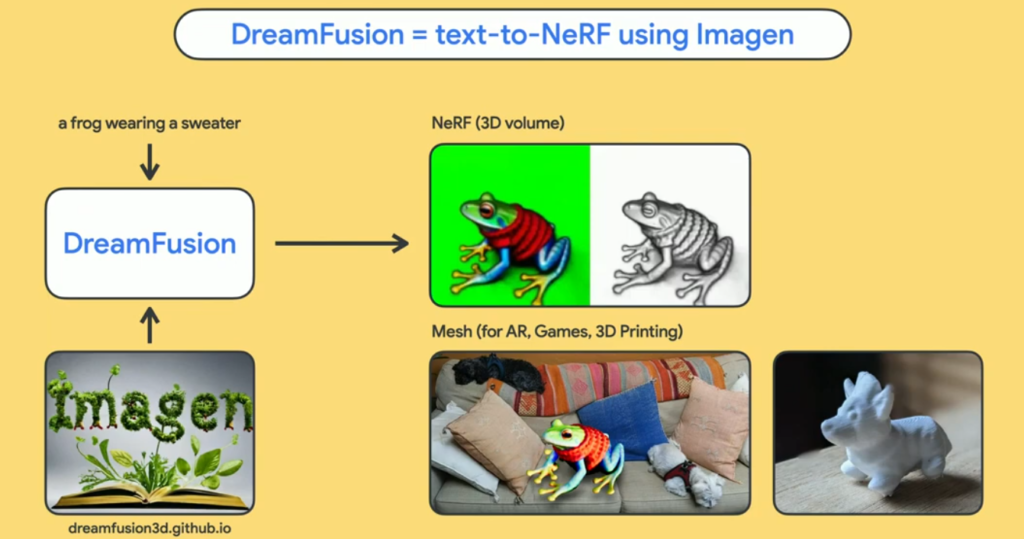

Otro avance reciente que me entusiasma mucho es que algunas personas en Google Research tomaron modelos de difusión y los aplicaron a la tarea de renderizado 3D. Esto se llama Dreamfusion. Lo que estás viendo aquí son imágenes 3D renderizadas usando sorprendentemente difícil generar

Imagen Video y Phenaki. Imagen Video usa la misma técnica de difusión que se usa en Imagine para crear imágenes individuales realmente nítidas que se pueden usar para generar videos cortos. Phenaki, por otro lado, usa un modelo de lenguaje que genera tokens a lo largo del tiempo, lo que permite que el modelo reúna una historia coherente de formato largo. Pero la verdadera magia ocurre cuando los combinas.

Estoy emocionado de mostrarles nuestra primera representación de una generación de texto a video de súper resolución.

- A blue balloon stuck in the branches of a redwood tree.

- Camera pans from the tree with single balloon to the zoo entrance.

- Camera pans to the zoo entrance.

- Camera moves very quickly into the zoo.

- First person view of flying inside a beautiful garden.

- The head of a giraffe emerges from the side.

- Giraffe walks towards a tree.

- Zoom into the giraffe’s mouth.

- Giraffe gets close to a branch and picks a blue balloon.

- A single helium blue balloon with a white string is flying towards the giraffe’s head.

- Giraffe chewing with a blue balloon nearby.

- Camera tilting following the single blue balloon flying away

(traducción: Un globo azul atascado en las ramas de un árbol de secoya. La cámara se desplaza desde el árbol con un solo globo hasta la entrada del zoológico. La cámara enfoca la entrada del zoológico. La cámara se mueve muy rápidamente en el zoológico. Vista en primera persona de volar dentro de un hermoso jardín. La cabeza de una jirafa emerge de un lado. Jirafa camina hacia un árbol. Zoom en la boca de la jirafa . La jirafa se acerca a una rama y coge un globo azul. Un único globo azul helio con un hilo blanco vuela hacia la cabeza de la jirafa. Jirafa masticando con un globo azul cerca. La cámara se inclina siguiendo al único globo azul que se aleja volando. )

Yo no construí esto. Lo siento. Creo que esto es asombroso. Realmente creo que es increíble que podamos hablar sobre contar historias largas como esta. Lo emocionante de esto es que podemos generar videos de súper resolución no solo a partir de un aviso, sino a partir de una secuencia de avisos, lo que nos brinda una nueva forma de contar historias. La generación de video está en su infancia. Estoy particularmente interesado en comprender mejor cómo los cineastas, o incluso los narradores de videos, incluso tal vez yo, podrían hacer uso de esta tecnología.

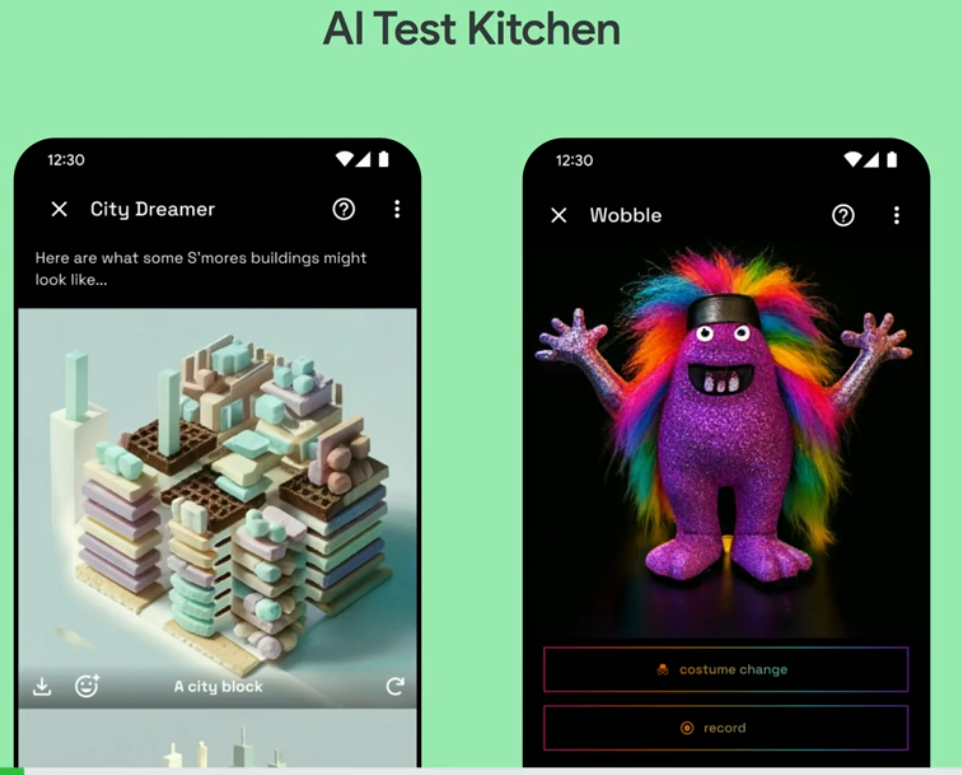

También estamos pensando en combinar creativamente algunas de estas cosas para que todos las experimenten. A principios de este año, en Google IO, anunciamos AI Test Kitchen.

Es una aplicación que brinda a las personas un lugar para aprender sobre la experiencia y dar su opinión sobre la tecnología emergente de IA de Google. Hoy me complace anunciar que estamos trabajando en nuevas experiencias de AI Test Kitchen con generación de texto a imagen. Puedes construir ciudades temáticas y diseñar personajes monstruosos, todo usando mensajes de texto. Estas experiencias llegarán pronto a AI Test Kitchen, pero puede obtener la aplicación ahora desde Play Store o App Store y comenzar a usar Lambda.

Demos un paso atrás. Los modelos generativos de IA son poderosos. No hay duda de eso. Tienen el potencial de brindarnos un nivel completamente nuevo de expresión y control artístico. Pero también debemos reconocer los riesgos reales que puede presentar esta tecnología si no tenemos mucho cuidado, razón por la cual hemos tardado en lanzarlos. Y estoy orgulloso que hemos sido lentos en liberarlos.

Entonces, obviamente, hay algunos problemas aquí que quiero discutir sobre la toxicidad, la desinformación y el sesgo, lo que podría conducir a una confianza general en nuestros medios y noticias. Debería quedar claro para gente como los periodistas que no queremos que sea aún más fácil difuminar la distinción entre lo que es real y lo que no lo es.

Hay muchas preguntas abiertas relacionadas con cómo esta tecnología afectará la vida profesional de las personas creativas. Queremos ser muy cuidadosos en la forma en que construimos conjuntos de datos y experiencias de usuario.

En términos de actuar de manera responsable, nuestros equipos de investigación han estado integrando activamente los principios de IA de Google en nuestro trabajo. Nos estamos centrando en tres áreas clave. Los dos primeros son sobre el control. Queremos proporcionar controles para generar medios.

Por ejemplo, queremos minimizar la generación de medios tóxicos o violentos. Y también queremos brindarles a los usuarios el control para hacer cosas que realmente les gustan para ser realmente creativos. Se está trabajando mucho para crear interfaces y experiencias de usuario apropiadas para controlar estos modelos. También está la cuestión de controlar este medio una vez creado y difundido en la web. Queremos estar seguros de que podemos detectar medios sintéticos. Hemos estado trabajando muy duro en todos los ámbitos en eso.

Por ejemplo, me complace decir que hemos progresado un poco en nuestro trabajo de LM de audio. Entrenamos un clasificador que puede detectar voz sintética con casi un 99 % de precisión. Así que vamos a seguir trabajando en estas dos formas de control. Primero, cuando se crean medios, se crean de manera responsable.

Y cuando los medios se difunden, tenemos formas de detectarlo. Finalmente, es importante que nos comprometamos con las comunidades para construir para todos. Queremos seguir trabajando con escritores, artistas, músicos y creadores para comprender sus necesidades y comprender cómo crear herramientas que sean importantes para la comunidad. Entonces, para concluir, la creatividad es una parte importante de lo que nos hace a todos humanos. Creo que es importante que tengamos esto en cuenta cuando construimos estos sistemas de IA.

Ahora me gustaría pasarle la palabra a Zoubin para que hable sobre cómo estamos haciendo avanzar la IA a través del lenguaje. Gracias.

Idioma

Zoubin Ghahramani

Gracias, Doug. Hola a todos. Soy Zoubin y dirijo el equipo de Google Brain en Google Research. Estoy encantado de hablarles hoy sobre nuestra investigación en inteligencia artificial y lenguaje. Mi viaje personal en la IA y la investigación del lenguaje comenzó a fines de la década de 1980.

Fue un momento emocionante para trabajar en redes neuronales en ese entonces. Pero estábamos muy limitados en lo que podíamos lograr. Por ejemplo, aunque estaba usando una de las computadoras más avanzadas en ese momento, una máquina de conexión que puedes ver aquí, no era nada en comparación con lo que está disponible ahora. Y no ayudó que la red mundial ni siquiera existiera todavía.

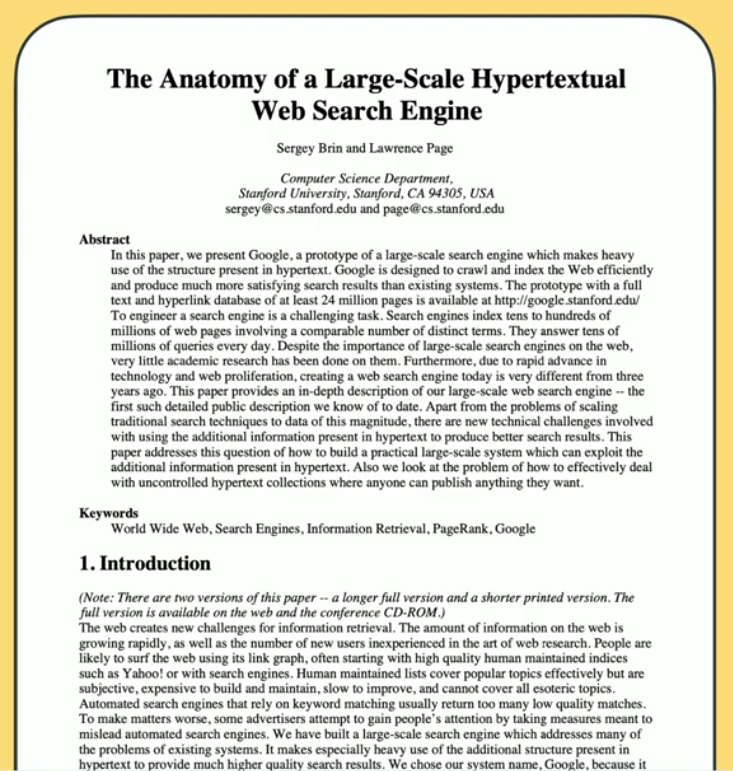

La tecnología y la IA han avanzado mucho desde entonces. En Google, la tecnología útil basada en la investigación está en nuestro ADN. De hecho, lo que comenzó como un trabajo de investigación sobre la recuperación de información eventualmente se convertiría en la base de la Búsqueda de Google.

Hemos recorrido un largo camino desde este artículo. Pero nuestro enfoque de la investigación ha sido el mismo. Centrarse en investigaciones innovadoras que puedan mejorar la vida de tantas personas como sea posible.

No hay mejor ejemplo de esto que nuestro compromiso con el avance de la IA a través del lenguaje. El lenguaje está en el corazón de cómo nos comunicamos unos con otros y entendemos el mundo que nos rodea.

Y es por eso que es importante para nosotros impulsar el estado del arte en IA basada en lenguaje. Tomemos como ejemplo nuestro último y mejor modelo, Palm. Lo anunciamos a principios de este año en Google IO y, desde entonces, hemos logrado un progreso significativo en la creación de investigaciones de IA en Palm.

Por ejemplo, presentamos Minerva, un sistema de IA que se basa en Palm y se entrenó en artículos científicos. Tiene una habilidad extraordinaria para resolver problemas matemáticos complejos, algunos a nivel de posgrado. Lo hace aprendiendo a hacer razonamientos simbólicos y aritméticos al descubrir patrones en miles de artículos publicados. También hemos explorado el uso de Palm para hacer que los robots sean más útiles.

Muchos de los robots actuales existen en entornos industriales y están codificados para tareas muy específicas. Para hacer que los robots sean más útiles en general, recientemente combinamos las capacidades de comprensión del lenguaje natural de Palm con las capacidades del mundo real de un robot auxiliar. El resultado es Palm Seiken, un modelo de aprendizaje robótico que le da a un robot la capacidad de ejecutar tareas complejas y abstractas aprovechando el conocimiento del mundo real codificado en Palm.

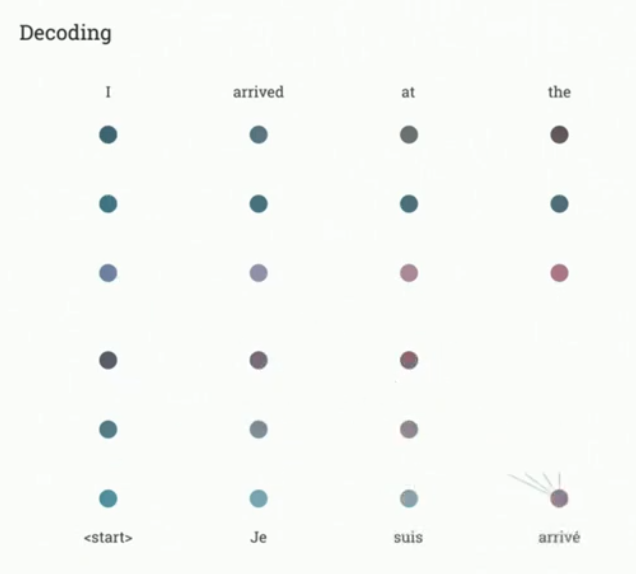

Hemos ampliado este trabajo recientemente al explorar cómo los robots dan sentido a lo que ven a través del lenguaje e incluso pueden usarlo para generar su propio código en tiempo real. Estos ejemplos muestran el ritmo de la innovación actual y lo lejos que hemos llegado en tan poco tiempo. Si echas un vistazo a 2017, cuando Google desarrolló el transformador, el mundo no lo sabía entonces, pero este modelo se convertiría en la base de casi todos los modelos avanzados de la actualidad.

Esto incluye algunos de nuestros modelos de lenguaje más avanzados, como Palm, e incluso los modelos generativos de IA que acaba de escuchar de Doug. Al continuar haciendo del lenguaje una parte fundamental de nuestra investigación de IA, esperamos que beneficie a todos de más formas.

A medida que miramos hacia la próxima generación de modelos y su impacto, es importante para nosotros que reflejen la diversidad de idiomas del mundo. Se hablan más de 7000 idiomas en todo el mundo, pero solo unos pocos están bien representados en línea hoy en día. Entonces, si usted es uno de, por ejemplo, los 100 millones de personas que hablan swahili, un idioma para el cual no hay mucho texto en la web, puede ser muy frustrante cuando la tecnología no funciona de la manera que la necesita. a.

Si queremos proporcionar tecnología de lenguaje basada en IA para el mundo, debemos asegurarnos de que nuestros modelos también estén capacitados en contenido representativo del mundo.

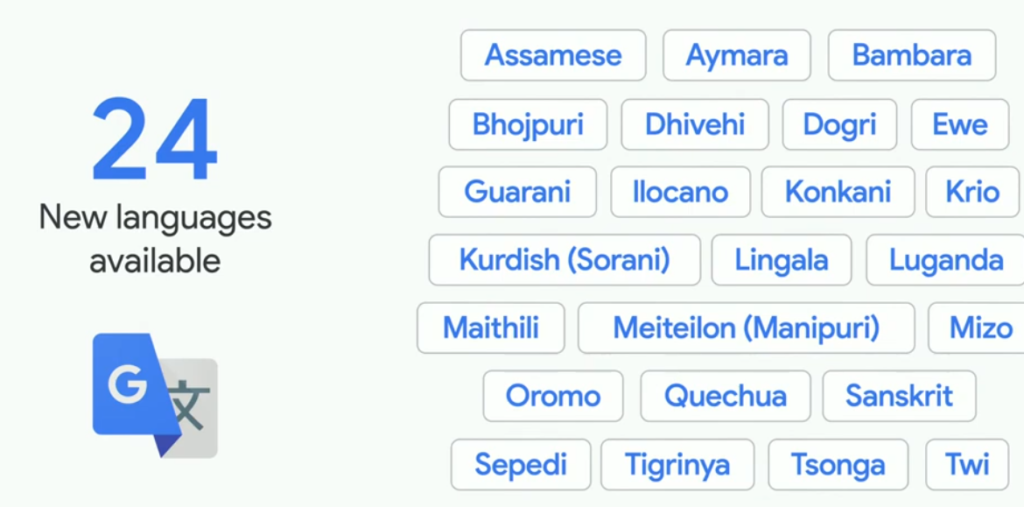

Este año, en Google IO, anunciamos la compatibilidad con 24 nuevos idiomas en Translate, lo que eleva el total a 133 idiomas utilizados en todo el mundo. Pero incluso entonces, sabemos que esto no es suficiente. Con este fin, me complace anunciar la Iniciativa de los Mil Idiomas, un ambicioso proyecto de investigación para construir un modelo que admita los mil idiomas principales del mundo.

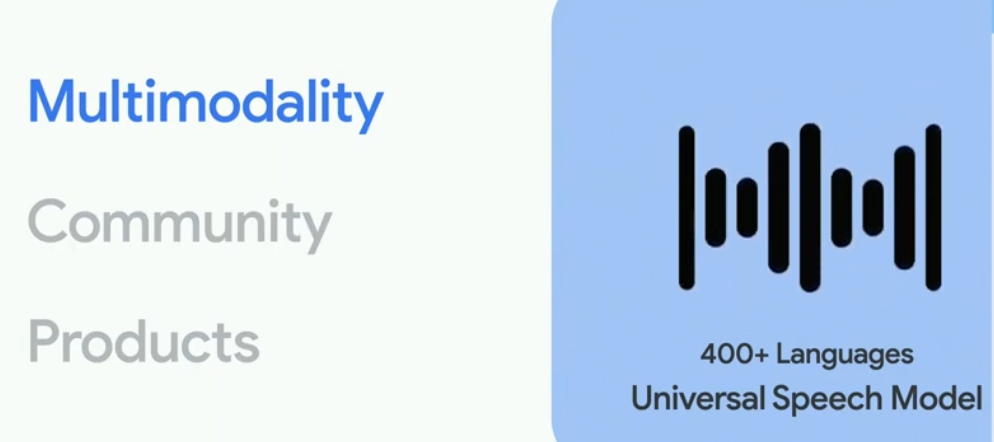

Para lograr esto, nos centraremos en tres factores importantes. El primero es la multimodalidad. La forma en que las personas acceden a la información y se conectan ha cambiado desde los primeros días de Google.

Están pasando del texto a depender de otros modos, como el habla. Nuestros modelos también han recorrido un largo camino desde aquellos primeros días. Muchos son capaces de procesar información basada en el lenguaje directamente a través de múltiples modalidades, como voz y videos.

Para que nuestros productos sean aún más accesibles, es importante que abordemos interacciones como el habla y otras modalidades. Con este fin, me complace anunciar también que estamos creando un modelo de voz universal que se entrena en más de 400 idiomas, la cobertura de modelo de idioma más grande vista en un modelo de voz en la actualidad.

El segundo enfoque para nosotros es continuar involucrando a la comunidad en general. Recientemente anunciamos la compatibilidad con nueve idiomas africanos más en Gboard al trabajar con investigadores y organizaciones en África para crear y publicar datos. Para aprovechar el modelo de habla universal y alimentar esfuerzos futuros como este, continuaremos trabajando directamente con comunidades de todo el mundo.

Por ejemplo, en el sur de Asia, estamos trabajando activamente con socios locales para eventualmente recopilar muestras de audio representativas de todos los dialectos e idiomas de la región. Y estamos impulsando esfuerzos similares a nivel mundial.

También queremos involucrarnos con una comunidad de investigación más amplia, y publicaremos un artículo en los próximos meses para que nuestros colegas de investigación puedan desarrollar este proyecto. Finalmente, planeamos mejorar nuestros productos como Gboard, YouTube y Translate al aumentar la cantidad de idiomas compatibles con estos productos, lo que facilita que las personas usen la tecnología en su idioma nativo y encuentren contenido relevante.

Este será un viaje de varios años, pero este proyecto establecerá una base fundamental para hacer que la IA basada en lenguaje sea realmente útil para todos. Ahora, me gustaría pasarle la palabra a Marian y James para que hablen sobre cómo Construir una IA de manera responsable para la sociedad subraya todo lo que hacemos. Gracias.

IA responsable

James Manyika y Marian Croak

Gracias. Hola, James. Que bueno verte. Es bueno verlos a todos. Bienvenidos. Gracias por venir. Mi nombre es James Manika. Soy vicepresidente sénior de tecnología y sociedad en Google. Además de haberme unido recientemente a Google hace 10 meses, probablemente pasé lo que parece toda una vida en torno a estos problemas de tecnología y sociedad, ya sea en los negocios o en el campo de la tecnología.

Cuando Zoubin mencionó lo que solía hacer con las computadoras viejas, recordé que hice mi doctorado en robótica en Oxford hace unos 20 años, pero mi primer artículo que publiqué sobre redes neuronales fue en realidad en 1992 cuando todavía era un estudiante universitario en la Universidad de Zimbabue. Así que es sorprendente, asombroso para mí, solo ver el increíble progreso que se ha producido. Así que estoy muy emocionado de estar aquí. Soy vicepresidente de ingeniería en Google y dirijo el centro de investigación de inteligencia artificial responsable y tecnologías centradas en el ser humano.

En esa área, lo que hacemos es realizar investigaciones y desarrollar metodologías y herramientas para garantizar que los sistemas de IA se comporten o funcionen de manera responsable, en dimensiones como toxicidad, sesgo, seguridad, información errónea, etc. James, has estado aquí unos nueve meses, creo, ¿verdad? ¿Cuáles son las cosas más emocionantes que has descubierto desde que estás aquí? Wow, esto ha sido muy divertido para mí.

Quiero decir, creo que si pienso en lo que ha sido más emocionante para mí desde que me uní a Google, creo que estoy entusiasmado con todas las increíbles investigaciones innovadoras, algunas de las cuales han oído hablar, de modelos generativos, pero también de sistemas multimodales. , pero la creciente generalidad de estos sistemas, y también mencionar todo el progreso asombroso en la ciencia, y nosotros.

Ni siquiera he hablado mucho sobre eso aquí, desde la IA cuántica hasta todo el trabajo en las vidas de plegamiento de proteínas. Así que todo eso es muy emocionante para mí. Pero creo que si pienso en este momento en particular, creo que hay dos o tres cosas que me llaman la atención, Marion. Uno es el trabajo del que acabamos de hablar sobre el lenguaje. Creo que el hecho de que acabas de escuchar a Zoubin describiendo el asombroso progreso en el lenguaje, eso es simplemente asombroso para mí.

Quiero decir, el modelo de habla universal que describió Zoubin y la Iniciativa de los Mil Idiomas es fenomenal. La otra cosa que también me llama la atención es todo el trabajo que toca lo que está sucediendo con la ciencia del clima. Ha oído hablar del pronóstico de vuelos y el trabajo de incendios forestales, etc. Lo que es interesante para mí, Marion, sobre el trabajo de pronóstico de vuelos, en particular, es el hecho de que ahora estamos llegando a muchos más lugares.

Creo que acabamos de agregar, creo, como 18 países nuevos, creo que tres grandes países en Asia, pero también unos 15 países en África, donde estas cosas van a hacer una enorme diferencia. Eso es bastante emocionante para mí. Y luego no importa todo el trabajo creativo que Doug acaba de describir. Eso fue simplemente impresionante para mí.

Pero Marion, has sido una asombrosa pionera inventora durante mucho tiempo. Probablemente te sientas hastiado, pero ¿qué te sorprende? ¿Qué es increíble para ti? Una de las cosas que estamos haciendo en nuestra organización, junto con Doug y Zoubin, es crear y realizar investigaciones que creen la capacidad para que las personas tengan más control sobre los sistemas de inteligencia artificial para que realmente colaboren con estos sistemas. en lugar de simplemente dejar de tomar decisiones autónomas por ellos. Y creo que eso es realmente espectacular. Y luego ha habido mucho trabajo en términos de permitir que los sistemas de IA brinden las capacidades para ayudar a las personas con desafíos de accesibilidad. Entonces, ya sabes, la inclusión de eso es bastante sorprendente para mí e importante. Sin embargo, como saben, la IA conlleva un gran riesgo.

Creo que eso es exactamente correcto. Una de las cosas que estaba haciendo incluso antes de unirme a Google era trabajar en las Academias Nacionales de las Artes y las Ciencias, pero también en las Academias de Ingeniería, para pensar sobre cuáles son estos importantes riesgos y desafíos que debemos analizar. Y creo que, al menos en mi mente, Marion, tiende a haber tres o cuatro categorías. Y creo que tenemos que pensar en cada uno de ellos. Por un lado, tenemos todo tipo de riesgos y desafíos cuando estos sistemas no funcionan según lo previsto.

Así que ahí es donde piensas en cosas como el sesgo y la toxicidad, y cuando no son completamente fácticos o fundamentados, se inventan cosas. Y pienso en ese tipo de desafíos. ¿Cómo los abordamos? Creo que una segunda categoría de desafíos son cosas, desafíos cuando en realidad son desafíos de lo que llamo uso y mal uso. Entonces, incluso si el sistema funciona según lo previsto, ¿realmente estamos aplicando estos sistemas? Y por nosotros, me refiero a los desarrolladores de la tecnología, pero también a los usuarios de la tecnología, ¿la estamos aplicando de la manera correcta según lo previsto de manera que no cause daño? Entonces, creo que los desafíos y riesgos del uso y el mal uso son muy importantes.

Escribí una tercera categoría, que a menudo estos sistemas tienen muchos efectos de segundo orden o consecuencias no deseadas. Una de las cosas en las que he dedicado mucho tiempo a investigar a lo largo de los años es el impacto, por ejemplo, en los mercados laborales, en los puestos de trabajo, etc.

Así que tenemos que estar pensando en estos efectos de segundo orden, pero también mencionaré uno de los últimos puntos, si me lo permite, Mary, que es que creo que Zoubin mencionó esto e incluso otros también lo hicieron, que es que creo siempre existe el riesgo de cómo estamos poniendo estos sistemas en el mundo. ¿Y cuáles son los incentivos en torno a eso? Creo que es bastante fácil apresurarse a poner en el mundo lo que todavía son sistemas de investigación antes de haber pensado en las consecuencias, haber entendido completamente el potencial, así como los riesgos.

Pienso en esta pregunta de cómo ponemos estos sistemas en el mundo, así que tengo curiosidad, Mary, y puedes hablar, dado este tipo de problemas, ¿cómo abordamos estas cosas en Google? Sí, entonces mi organización, si puedes pensar en ello, está diseñada para llevar la realización técnica a los principios de la IA. Y estos principios, los articulamos en 2018.

Y estoy muy orgulloso del hecho de que los principios en realidad colocan a los usuarios y la prevención de daños y la seguridad por encima de las consideraciones comerciales tradicionales. Y creo que si vamos a ser líderes en IA, es extremadamente importante que realmente impulsemos el estado del arte en tecnología de IA responsable y no solo en tecnologías de IA simples. Así que no quiero que los principios sean solo palabras en papel. Como dijiste, soy un inventor de toda la vida y amo la teoría, pero me apasiona arreglar cosas y quiero descubrir formas de hacer que las cosas funcionen en la práctica. Entonces, algunas de las formas en que ponemos en práctica los principios de la IA es que hacemos pruebas contradictorias de manera constante y continua. Y luego también nos aseguramos de establecer puntos de referencia que sean cuantitativos y que puedan medirse y verificarse en todas las dimensiones de nuestra IA.

Y así también lo hacemos de forma continua. También tratamos de mejorar los modelos con técnicas de investigación avanzadas como el ajuste eficiente de parámetros que permite una mayor adaptabilidad y agilidad. Y luego, dentro de las propias organizaciones, lo que tratamos de hacer es tener un conjunto muy diverso de investigadores, científicos sociales, especialistas en ética, expertos en derechos humanos, así como científicos de inteligencia artificial y aprendizaje automático. Y también alentamos mucha participación comunitaria, como Doug también mencionó anteriormente.

Entonces, creo que una de las visiones que tengo y que creo que realizaremos muy pronto, ya sabes, dentro de unos años, es incorporar todas las capacidades de la IA responsable en lo profundo de la infraestructura técnica que respalda los modelos para que al predeterminado, ya sabe, desde una perspectiva de extremo a extremo, cuando realiza la recopilación de datos, cuando realiza el diseño, cuando realiza las pruebas y el entrenamiento de estos modelos, y luego a la implementación e incluso para monitorearlos, tiene RAI, que es la IA responsable, recién integrada en el sistema.

Y, Mary, ¿cuál es un ejemplo de una herramienta práctica que puedas describir sobre cómo ponemos todo esto en práctica? Bueno, una de las herramientas que hemos creado y que me entusiasma mucho se llama Language Interoperability Tool, o LIT. Y lo que hace es que les da a los investigadores esta comprensión visual de cómo se comportan sus modelos. Por lo tanto, utiliza tecnologías de vanguardia, como mapas de prominencia y métodos de influencia, para permitir que los investigadores respondan preguntas como, ¿por qué mi modelo generó ese aviso? Ya sabes, y si la respuesta es problemática, ¿qué llevó a ese comportamiento? Y luego, ¿qué podría pasar si provoco que cambien diferentes entradas? ¿Qué podría pasar con el comportamiento del modelo? Y, sobre todo, permite, da a los investigadores la oportunidad de mejorar sus modelos mediante el uso de nuevas tecnologías y metodologías. Entonces, ya sabes, creo que es muy, muy importante que abramos modelos de código fuente como ese, y tenemos, quiero decir, lo siento, LIT está disponible.

Y plataformas como TensorFlow, Jax y otras plataformas para que todos las usen. Entonces, ya sabes, creo que estas herramientas son críticas y muy importantes. Sabes, creo que una de las cosas que ha estado en la mente de muchas personas es cómo hacemos sistemas como Lambda, ya sabes, cualquiera de estos modelos muy grandes es responsable y seguro de usar. ¿Puede llevarnos un poco detrás de escena, describir lo que realmente sucede detrás de escena en Lambda para hacerlo, para tratar de hacerlo seguro y… Sí. Sí, Lambda es un modelo muy complejo. Así que hicimos el análisis de IA completo y responsable, y seguimos haciéndolo. Entonces, primero comenzamos con las evaluaciones de riesgos y daños. Y estos son realizados por especialistas en ética de la IA, los mismos que ayudan a crear los principios de la IA.

Y usamos esos riesgos y daños que, ya sabes, varían según la toxicidad, la desinformación y el sesgo y todas las dimensiones de la RAI responsable. Y los usamos para crear objetivos, que podemos cuantificar y medir. Y luego estamos… Lo que hacemos con eso es que recopilamos datos y los convertimos en conversaciones. Y voy a usar la seguridad como ejemplo para esta conversación. Entonces nosotros… A medida que generamos conversaciones, las etiquetamos como seguras o inseguras.

Y tenemos un conjunto diverso de Raiders, ya sabes, etiquetándolos. Asaltantes humanos. Raiders humanos, exactamente. Y luego alimentamos esa información, esos datos, en el modelo. Y usando ML, luego creamos clasificadores de seguridad en este ejemplo.

Y luego ejecutamos el modelo nuevamente con los clasificadores de seguridad activados y creamos solo respuestas seguras. Y luego recopilamos datos continuamente y los alimentamos al modelo para que podamos tener una perspectiva más matizada de lo que es seguro e inseguro. Entonces, ya sabes, Lambda presenta una serie de desafíos. Y solo puedo hablarles de un par de ellos. Uno de ellos es sobre la diversidad Raider. Así que hacemos todo lo posible para asegurarnos de que, ya sabes, estamos usando Raiders que son diversos en términos de demografía y perspectivas.

Y tenemos desacuerdos, que es lo que queremos. Pero entonces, lo que sucede típicamente es que perdemos la riqueza de esos desacuerdos al crear un estándar normativo a través de ellos. Entonces, la industria en su conjunto enfrenta este problema sobre qué hacer con los datos valiosos que obtiene de la diversidad y cómo los usa de una manera constructiva y positiva. La otra cosa que hemos aprendido de Lambda es que los clasificadores tienen sus limitaciones para que podamos crear, podemos decir de una manera muy dogmática, esto es seguro. Esto es inseguro. Y que a veces puede sacar casi la belleza de la modelo.

Y tú Proponga un enfoque de fuerza bruta muy simple en el que pierda la plenitud de lo que la gente está tratando de hacer. Y se vuelve muy aburrido y poco imaginativo. Entonces, lo que estamos tratando de hacer es asegurarnos de tener una perspectiva más refinada sobre los clasificadores para no borrar cosas que son importantes. Déjame, ya sabes, darte un ejemplo simple. En muchas culturas, y una de la que vengo, la palabra aburrido puede significar algo muy complementario. Así que ella es genial o él es genial es en realidad un cumplido. Si usamos nuestro filtro de toxicidad, eso simplemente se borraría. Y tantos modismos culturales como ese pueden, pueden, ya sabes, simplemente desaparecer si usas, si restringes en exceso los clasificadores.

Así que estamos tratando de lograr este delicado equilibrio entre tener las cosas seguras y allí y también permitir la riqueza en nuestra sociedad y en otras sociedades. Sí, quiero decir, creo que lo que estás describiendo con ese ejemplo, en realidad hay bastante investigación académica sobre este tema sobre cómo pensamos sobre la curación de estos conjuntos de datos y este tipo de medidas de toxicidad. Es un viaje continuo.

Pero también tengo curiosidad, Marion, has estado trabajando en esto en Google y antes, ¿hay algún ejemplo de algo en lo que creas que nos equivocamos? Y de hecho aprendimos algo de eso. ¿Y qué aprendimos? Sí, entonces, ya sabes, creo que una cosa que hemos aprendido es que los modelos genitivos tienden a inventar respuestas de vez en cuando. Inventarán cosas. Y tenemos que, ya sabes, hemos estado haciendo una investigación muy activa para mejorar los modelos y mitigar eso al tener clasificadores y filtros de factualidad. Y estamos investigando activamente para asegurarnos de que las respuestas estén alineadas con fuentes fácticas.

Y, ya sabes, acabas de describir parte del trabajo que haces para hacerlo bien. Pero, ¿hay algún ejemplo de una innovación de IA responsable que le entusiasme en la que realmente descubrimos una manera de ser responsable de una manera muy innovadora e interesante? Sí, una de las cosas que más me emociona que está sucediendo en nuestra organización en este momento es que hemos inventado esta herramienta. Que podemos poner encima de Lambda que permitirá a las personas que no están familiarizadas con AI o ML, nuestros desarrolladores, desarrollar sus aplicaciones, sus aplicaciones basadas en AI.

Es casi como una interfaz basada en web en un modelo muy complicado como Lambda, pero no es necesario que tenga toda la experiencia que tendría alguien como usted. Para desarrollar aplicaciones. Así que estoy muy emocionado por eso. Macromaker, en realidad lo he usado mucho. Sí Sí. Pero una de las otras innovaciones responsables de la IA que realmente me ha sorprendido desde que me uní a Google es el trabajo que usted, su equipo y otros hicieron en la escala del monje.

No sé si la gente está familiarizada con eso, que es uno de los problemas, por ejemplo, en las imágenes es la capacidad de reconocer completamente el espectro completo de la humanidad. Gente como yo, gente de diferentes colores. Creo que históricamente ha habido algo llamado la escala de Fitzpatrick, que se ha utilizado desde 1973, que solo abarcaba una gama muy estrecha de, por ejemplo, tonos de piel. Así que creo que Google investigó un poco, creo que con los investigadores de Harvard para crear la escala de monje, que es una gama mucho más amplia de tonos de piel que en realidad cubre a toda la humanidad. Y creo que esto se anuncia en IO. Sí, lo era. Ahora está en código abierto. Pensé que era bastante sorprendente como un tipo interesante de innovación de IA responsable.

Pero quería decir un par de cosas más, sin embargo, que van más allá de lo que hemos discutido hasta ahora, Marion, que es claramente, ya sabes, este es un viaje. A medida que abordamos estos problemas y abordamos algunos de ellos, surgen nuevas preguntas. Entonces, las consideraciones de IA responsable son realmente un viaje al mismo tiempo que el viaje debe mantenerse al día con el avance de la tecnología en sí. Y me parece que, de hecho, esto es algo que todos tenemos que abordar colectivamente. Por lo tanto, no son solo los desarrolladores e investigadores, sino también, en última instancia, los usuarios, ya sean empresas y organizaciones, o incluso gobiernos, el uso de esta tecnología, así como los reguladores.

Así que en realidad estoy bastante emocionado por el hecho de que Google es un lugar que realmente adopta la regulación. Porque estas tecnologías son demasiado importantes para no regularlas por todas las razones que acabamos de discutir. Pero me parece que incluso mientras regulamos, tenemos que pensar en cómo hacerlo bien. Y me gustaría probar al menos mi punto de vista de hacerlo bien con su opinión sobre esto, Marion, que es, ya sabe, y esto surgió de otro trabajo que estaba haciendo incluso antes de Google, que es la idea de Me parece que hacer bien la IA tiene dos partes.

Una parte es cómo nos aseguramos de que estamos construyendo las capacidades de IA más útiles y beneficiosas y asegurándonos de que estén realmente disponibles para todos. Eso me parece ser una parte importante para hacer esto bien. Al mismo tiempo, ¿cómo abordamos estas complejidades, riesgos y desafíos? Así que parece que hacer las cosas bien es hacer las dos cosas bien. No sé si estás de acuerdo con eso. No, estoy absolutamente de acuerdo. Quiero decir, la IA es una tecnología fundamental y puede tener inmensos beneficios sociales.

Y como escuchamos de Doug, puede desatar toda esta creatividad. Pero debido a que tiene un impacto tan amplio, cierto, para ayudar a las personas, el riesgo involucrado también puede ser muy grande. Y si no lo hacemos bien, quiero decir, casi no importa que brinde tantos beneficios porque puede ser muy disruptivo. Así que creo que los dos, ya sabes, juntos son absolutamente importantes.

También creo que el hecho de que estemos trabajando con expertos externos, fuera de Google, participantes de la comunidad que están muy familiarizados con el impacto que puede tener en las diferentes sociedades en las que viven es muy importante. Trabajar con los formuladores de políticas es importante porque queremos asegurarnos de que las políticas que están adoptando, en realidad podamos ponerlas en un uso técnico real.

Entonces, sabes, creo que tienes toda la razón en que esto va a tomar un pueblo para hacerlo bien y hacerlo bien. Bueno, gracias. Ha sido divertido tener esta conversación contigo. Y creo que ahora vamos a devolverle esto a Zoubin. Zoubin para el cierre.

Clausura

Sí. Gracias. Hoy hablamos sobre nuestro compromiso de hacer que la IA funcione para todos y hacerlo de manera responsable. El éxito aquí podría significar todo, desde nuevas formas de abordar los desafíos sociales hasta mejorar la creatividad humana para hacer que la comunicación sea más accesible para las personas de todo el mundo y mucho más. Es IA que está diseñada para ayudar. Hemos llegado, tenemos un largo camino por recorrer, pero estamos entusiasmados con el viaje por delante. Gracias por unirse a nosotros en AI en.

NOTAS DE EDUARDO LLAGUNO

Cuando vi el video me pareció interesante compartirlo por su contenido y enfoque, actualmente vemos una carrera acelerada por llevar a la gente herramientas de I.A., sin embargo pocos hablan de sus efectos, consecuencias y posibles usos negativos. Me pareció especialmente interesante el enfoque de “IA Responsable” que tiene Google y los científicos y pensadores detrás de sus iniciativas. Si algo requiere la IA y la tecnología es pensar como en su momento puso en sus libros Isaac Asimov con sus tres leyes de la robótica.

Cabe aclarar que me tomé algunas libertades al poner encabezados y separar los párrafos.

Dentro de mi proceso para generar esta transcrición hice lo siguiente:

- Primero generé los textos (subtítulos) del video utilizando Whispers de OpenAI que lo liberó como Código Abierto, y se puede usar descargándolo de GitHub, y en particular utilicé una herramienta que se llama “yt-whispers“ hecha por “m1guelpf” (Miguel Piedrafita).

- Luego utilicé el software abierto “Subtitle Edit“ desde el cual exporté el archivo de subtítulos a uno de solo texto. https://github.com/SubtitleEdit/subtitleedit

- Lo convertí a formato de Word (.docx) y lo subí a Google Translate para pasarlo al español.

- Realicé algunas correcciones pues no es perfecto ni Whispers ni Translate y probablmente se me fueron muchas.

- Lo edité en OnlyOffice, de ahí hice un simple Cortar&Pegar a mi editor de WordPress que utilizo en SesoLibre.com, corregí algunos encabezados y posición de imágenes. Escribí estas líneas y listo.

Blogarama

Blogarama

Comentarios recientes